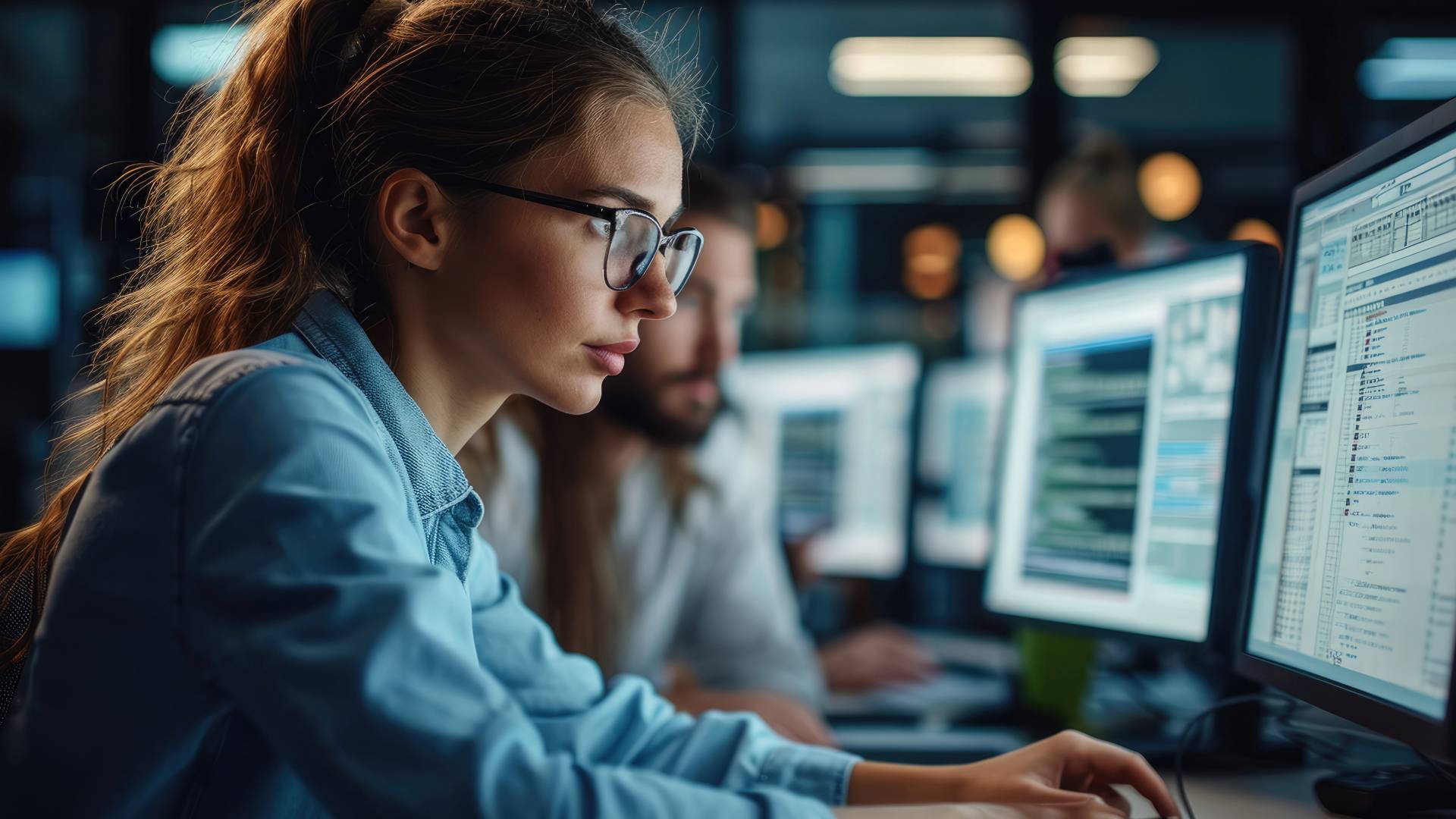

Las 10 mejores herramientas de Big Data para análisis de datos

En el mundo empresarial moderno, las herramientas de Big Data son esenciales para extraer insights valiosos que permiten tomar decisiones informadas basadas en datos reales recopilados y analizados en tiempo real. Estas herramientas permiten a las empresas controlar y aprovechar la gran cantidad de datos que generan diariamente, transformando la manera en que interactúan con la información. Si estás interesado en formarte en el interesante mundo de la Ciencia de Datos en UDIT encontrarás el Grado en Ciencia de Datos e Inteligencia Artificial dónde te preparamos para un futuro prometedor.

Las 5V para definir una herramienta de Big Data

El Big Data se caracteriza por las 5V: Volumen, Velocidad, Variedad, Veracidad y Valor. Conocer estas características permite evaluar y seleccionar las herramientas más adecuadas según las necesidades específicas de cada empresa.

Volumen

Se refiere a la enorme cantidad de datos que se generan constantemente. Las herramientas de Big Data deben ser capaces de manejar y procesar grandes volúmenes de datos de manera eficiente para ser útiles.

Velocidad

La rapidez con la que se generan y procesan los datos es crucial. En un entorno empresarial donde las decisiones deben tomarse en tiempo real, la capacidad de procesar datos rápidamente es indispensable.

Variedad

Los datos provienen de múltiples fuentes y en diferentes formatos (texto, imágenes, videos, etc.). Las herramientas de Big Data deben poder procesar y analizar esta diversidad de datos.

Veracidad

La precisión y fiabilidad de los datos son esenciales para tomar decisiones acertadas. Es fundamental que las herramientas incluyan mecanismos para garantizar la calidad de los datos.

Valor

No todos los datos son útiles. Las herramientas de Big Data deben ser capaces de identificar y extraer la información valiosa que realmente impacta en la toma de decisiones.

Estas cinco características son fundamentales para seleccionar las herramientas de Big Data más adecuadas para cualquier proyecto de análisis de datos.

Herramientas imprescindibles para Big Data

A continuación, se presentan algunas de las herramientas de Big Data más utilizadas en la actualidad, cada una con características únicas que pueden transformar el manejo de datos en las empresas.

Airflow

Plataforma de gestión de flujos de trabajo que permite programar y ejecutar complejos pipelines de datos. Airflow se integra con Python y es ideal para la creación de modelos de machine learning y la transferencia de datos en sistemas de Big Data.

Delta Lake

Desarrollada por Databricks, esta capa de almacenamiento de formato abierto proporciona fiabilidad y rendimiento en lagos de datos para operaciones de streaming y batch, con soporte para transacciones ACID.

Apache Drill

Motor de consulta distribuido de baja latencia para grandes conjuntos de datos. Permite consultar datos estructurados y semi-estructurados de diversas fuentes y es compatible con herramientas de BI como Tableau y Qlik.

Druid

Base de datos de análisis en tiempo real que ofrece baja latencia y alta concurrencia, permitiendo análisis simultáneo por múltiples usuarios sin afectar el rendimiento.

Alluxio Enterprise AI

Plataforma de gestión de datos diseñada para tareas intensivas de AI y ML. Ofrece el rendimiento necesario para aplicaciones como IA generativa y procesamiento de lenguaje natural.

Alteryx AiDIN

Combina IA, IA generativa y tecnología ML con la plataforma Alteryx Analytics Cloud, mejorando la eficiencia y productividad analítica mediante funcionalidades avanzadas y generación de documentos.

Databricks LakehouseIQ

La programación es el proceso de escribir código que puede ser ejecutado por una computadora. Es una habilidad fundamental para los ingenieros del software y está estrechamente relacionada con las matemáticas y la lógica.

Apache Hadoop

Framework de software para almacenamiento y procesamiento distribuido de grandes conjuntos de datos. Ofrece almacenamiento distribuido y capacidad para procesar grandes volúmenes de datos eficientemente.

Apache Spark

Motor de análisis unificado para procesamiento de datos a gran escala, con soporte para múltiples lenguajes de programación y alto rendimiento para aplicaciones en memoria y en disco.

MongoDB

Base de datos NoSQL que ofrece alta performance, disponibilidad y escalabilidad. Su modelo de datos flexible admite documentos JSON con esquemas dinámicos y permite el escalado horizontal mediante sharding distribuido.

Estas herramientas representan solo una parte de lo que está disponible para trabajar con Big Data, pero son fundamentales para cualquier estrategia de análisis de datos. Cada una ofrece características únicas que ayudan a las empresas a manejar sus datos de manera eficiente y a extraer insights valiosos para mejorar sus operaciones y resultados. Con el conocimiento adecuado, profesionales en Ciencia de Datos e Inteligencia Artificial pueden maximizar el valor de estas herramientas, impulsando la innovación y el crecimiento en sus respectivas organizaciones.

Fórmate en Análisis de Datos e IA con UDIT

Estudia en UDIT el Grado de Ciencia de Datos e Inteligencia Artificial con un plan de estudios único que profundiza en la parte técnica de programación y algoritmos de la IA. Dominarás las metodologías y herramientas que están revolucionando las empresas, accediendo a entornos, herramientas y librerías como Anaconda, Python, TensorFlow, MySQL y MongoDB, siempre de la mano de profesionales en activo y acompañado de prácticas asociadas a casos reales.

Si estás interesado en formarte en el Grado en Ciencia de Datos e Inteligencia Artificial no lo dudes y ponte en contacto con nosotros. Te ayudaremos a resolver tus dudas y te acompañaremos en el proceso de elección de tu futuro.

más información

7 razones por las que estudiar Ciencia de Datos e Inteligencia Artificial.

¿Qué debo hacer para convertirme en data scientist?

¿Cómo se entrelaza el análisis de datos e inteligencia artificial?